Dynamiczny rozwój sztucznej inteligencji sprawił, że profesjonalne nagrania audio stały się dostępne dla każdego — bez studia, drogiego sprzętu i angażowania aktora głosowego. ElevenLabs to obecnie jedno z najpotężniejszych narzędzi do syntezy mowy AI. Pozwala w kilka minut stworzyć cyfrowego lektora, który brzmi zaskakująco naturalnie, oddaje emocje, intonację i charakter wypowiedzi. Dzięki niemu możesz generować voiceovery do filmów na YouTube, reklam, podcastów, kursów online, prezentacji czy materiałów sprzedażowych — szybko, tanio i w pełni zgodnie z wizerunkiem Twojej marki.

Co więcej, ElevenLabs umożliwia nie tylko wybór spośród tysięcy gotowych głosów, ale także klonowanie własnego głosu (nawet na podstawie kilkunastu sekund nagrania). To otwiera zupełnie nowe możliwości dla twórców, ekspertów i firm, które chcą zachować spójny, rozpoznawalny ton komunikacji we wszystkich materiałach.

Czym jest ElevenLabs i jak działa technologia syntezy mowy AI?

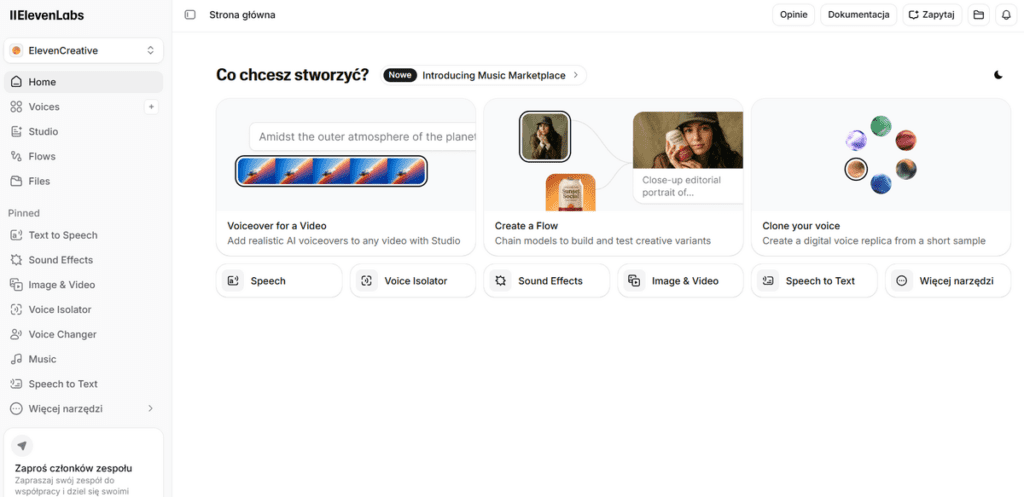

ElevenLabs to obecnie jedno z najbardziej zaawansowanych narzędzi do syntezy mowy opartej na sztucznej inteligencji. W prostych słowach zamienia dowolny tekst na bardzo naturalnie brzmiący głos – tak realistyczny, że często trudno odróżnić go od nagrania ludzkiego lektora.

Działa to bardzo prosto: wpisujesz tekst, wybierasz głos (lub tworzysz własny), dostosowujesz kilka parametrów i w ciągu kilkunastu sekund otrzymujesz gotowe nagranie audio.

W porównaniu do starszych rozwiązań text-to-speech, ElevenLabs wyróżnia się przede wszystkim jakością. Potrafi znacznie lepiej oddawać intonację, emocje, naturalne pauzy, akcenty i tempo mówienia. Dzięki temu ten sam tekst może brzmieć zupełnie inaczej – spokojnie i rzeczowo w materiale edukacyjnym, dynamicznie i przekonująco w reklamie, albo ciepło i angażująco w storytellingu. +Technologia analizuje tysiące godzin ludzkiej mowy, dzięki czemu generowany głos brzmi autentycznie i jest dopasowany do wybranego stylu komunikacji.

W praktyce cyfrowy lektor z ElevenLabs sprawdza się doskonale w:

- filmach na YouTube i materiałach wideo,

- podcastach i audiobookach,

- reklamach i spotach promocyjnych,

- kursach online oraz webinarach,

- prezentacjach firmowych i materiałach sprzedażowych.

Dla firm i twórców oznacza to ogromną oszczędność czasu i pieniędzy – nie musisz już rezerwować studia nagraniowego, płacić lektorowi ani robić kilkunastu poprawek. Wszystko możesz wygenerować samodzielnie, szybko i w dowolnej ilości.

Dlaczego warto stworzyć cyfrowego lektora? Zastosowania w biznesie i marketingu

Coraz więcej firm zdaje sobie sprawę, że profesjonalny głos w treściach audio i wideo to jeden z najskuteczniejszych sposobów budowania zaufania i angażowania odbiorców. Cyfrowy lektor AI pozwala osiągnąć ten efekt bez wynajmowania studia nagraniowego, zatrudniania aktora głosowego i poświęcania tygodni na produkcję.

Dzięki narzędziom takim jak ElevenLabs możesz w kilka minut wygenerować naturalnie brzmiące nagranie, które idealnie pasuje do wizerunku marki. Masz pełną kontrolę nad tonem, tempem i stylem wypowiedzi, dzięki czemu ten sam komunikat może brzmieć inaczej – bardziej ekspercko w materiałach B2B, dynamiczniej w social mediach czy ciepło i angażująco w content marketingu. W efekcie firmy działają szybciej, bardziej elastycznie i mogą skalować produkcję treści bez znaczącego wzrostu kosztów.

Lektor AI w content marketingu

Content marketing od dawna przestał ograniczać się tylko do tekstu i grafik. Dziś ogromne znaczenie mają treści audio i wideo. Cyfrowy lektor AI pozwala błyskawicznie zamienić artykuł blogowy, opis produktu lub gotowy scenariusz w profesjonalne nagranie do filmu, podcastu czy materiału edukacyjnego. Dzięki temu marki mogą tworzyć narracje do filmów, rozwijać własne podcasty i produkować wartościowe treści bez dodatkowych zasobów produkcyjnych. Wsparcie AI ułatwia również szybkie testowanie różnych wersji komunikatów i reagowanie na potrzeby odbiorców, co przekłada się na większe zaangażowanie i lepsze wyniki kampanii.

Automatyzacja produkcji audio i wideo

Jedną z największych zalet wykorzystania AI w audio jest automatyzacja procesów. Zamiast wieloetapowego procesu nagrywania, edycji i wielokrotnych poprawek, gotowy materiał można uzyskać dosłownie w kilka minut. To szczególnie duża przewaga w marketingu, gdzie tempo publikacji ma kluczowe znaczenie. Generator głosu AI pozwala nie tylko szybko tworzyć nowe treści, ale także łatwo je aktualizować – wystarczy zmienić tekst, gdy oferta lub komunikat się zmienia, bez konieczności ponownego nagrywania od zera.

Oszczędność kosztów i skalowanie treści

Tradycyjne nagrania audio wiążą się z dużymi kosztami – wynajmem studia, opłatą dla lektora oraz czasem potrzebnym na realizację całego projektu. Cyfrowy lektor AI radykalnie obniża te wydatki. Jednocześnie umożliwia łatwe skalowanie produkcji – możesz generować dziesiątki lub setki nagrań w różnych językach i wersjach dopasowanych do konkretnych grup klientów. Dzięki temu firmy zwiększają zasięg działań marketingowych bez proporcjonalnego wzrostu budżetu, co w dzisiejszym dynamicznym środowisku biznesowym daje realną przewagę konkurencyjną.

Tworzenie cyfrowego lektora w ElevenLabs – krok po kroku

Proces tworzenia cyfrowego lektora w ElevenLabs jest stosunkowo prosty, nawet jeśli wcześniej nie korzystałeś z narzędzi AI do generowania głosu. Wystarczy przygotować tekst, wybrać odpowiedni głos, dopasować ustawienia i wygenerować plik audio. Najważniejsze jest jednak to, aby nie traktować tego procesu wyłącznie technicznie. Dobry cyfrowy lektor AI powinien pasować do charakteru marki, grupy docelowej oraz celu konkretnego materiału. Innego tonu będzie wymagała reklama sprzedażowa, innego film edukacyjny, a jeszcze innego profesjonalna prezentacja firmowa. Dlatego przed rozpoczęciem pracy warto określić, czy głos ma brzmieć ekspercko, dynamicznie, spokojnie, emocjonalnie czy neutralnie.

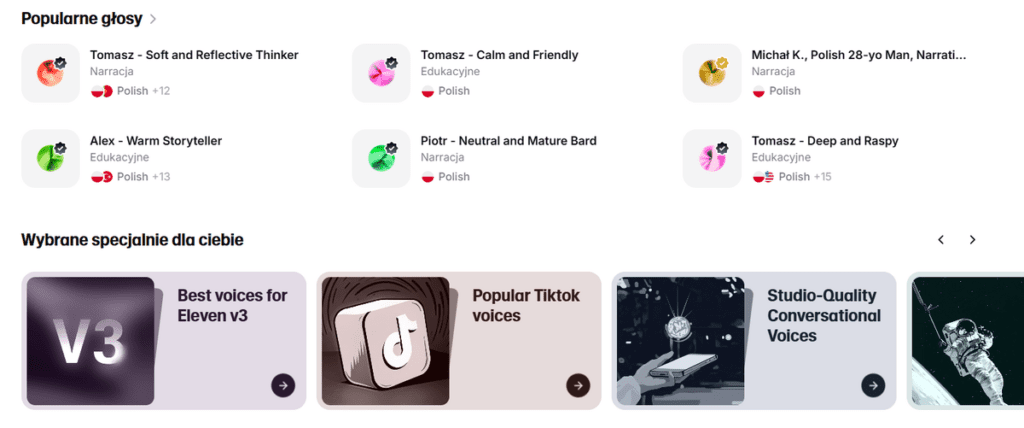

Wybór głosu i ustawienia parametrów

Pierwszym krokiem jest wybór głosu, który najlepiej pasuje do planowanego nagrania. ElevenLabs udostępnia różne typy głosów, różniące się barwą, tempem, stylem wypowiedzi i poziomem ekspresji. Warto przetestować kilka wariantów, ponieważ ten sam tekst może wywoływać zupełnie inne wrażenie w zależności od wybranego lektora. Następnie można dostosować ustawienia, takie jak stabilność głosu, naturalność, ekspresję czy podobieństwo do wybranego wzorca. To właśnie te parametry wpływają na to, czy generator głosu AI zabrzmi bardziej spokojnie, reklamowo, emocjonalnie lub profesjonalnie. Przy materiałach biznesowych najlepiej unikać przesadnej ekspresji i postawić na czytelność, wiarygodność oraz płynność wypowiedzi. Dobrze skonfigurowany lektor AI powinien wzmacniać przekaz, a nie odciągać uwagę od treści.

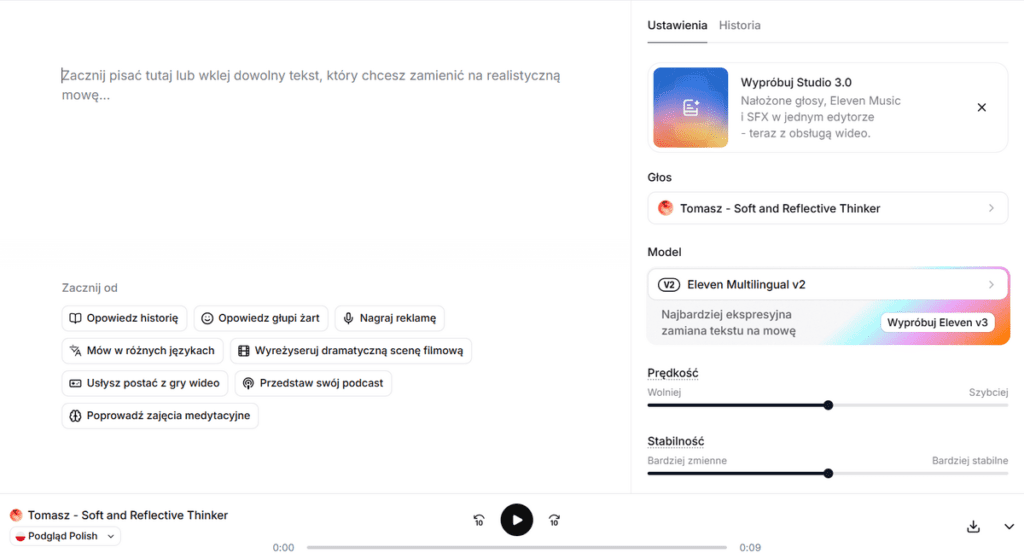

Wprowadzanie tekstu i generowanie audio

Kolejnym etapem jest wprowadzenie tekstu, który ma zostać zamieniony na nagranie. Warto pamiętać, że tekst pisany pod audio powinien różnić się od klasycznego tekstu blogowego. Zdania powinny być krótsze, bardziej naturalne i łatwe do wypowiedzenia. Pomocne jest dodawanie przecinków, kropek oraz logicznych pauz, ponieważ wpływają one na rytm nagrania. Przed wygenerowaniem finalnej wersji dobrze jest przygotować kilka wariantów tekstu i sprawdzić, który brzmi najbardziej naturalnie. synteza mowy AI radzi sobie coraz lepiej z intonacją, ale nadal jakość efektu zależy od tego, jak dobrze przygotowany jest scenariusz. Po kliknięciu opcji generowania ElevenLabs tworzy gotowy plik audio, który można odsłuchać, poprawić lub wygenerować ponownie. Dzięki temu tworzenie lektora AI staje się szybkim procesem testowania i optymalizacji.

Eksport i wykorzystanie nagrania

Po wygenerowaniu nagrania można je pobrać i wykorzystać w wybranych materiałach. Plik audio sprawdzi się jako narracja do filmu na YouTube, głos w reklamie, ścieżka do prezentacji, podcastu, kursu online lub materiału sprzedażowego. Przed publikacją warto jednak odsłuchać nagranie w kontekście całego projektu, najlepiej razem z obrazem, muzyką lub animacją. Dzięki temu łatwiej ocenić, czy tempo wypowiedzi, ton i długość pauz pasują do finalnej kompozycji. Profesjonalnie przygotowany AI voice może znacząco podnieść jakość komunikacji marki i przyspieszyć produkcję contentu. Co ważne, raz przygotowany proces można łatwo powtarzać, tworząc kolejne materiały w podobnym stylu. Właśnie dlatego cyfrowy lektor jest szczególnie wartościowy dla firm, które regularnie publikują treści audio i wideo.

Jak trenować własny głos (voice cloning) w ElevenLabs?

Trenowanie własnego głosu w ElevenLabs, czyli voice cloning, polega na stworzeniu cyfrowego modelu głosu na podstawie nagranych próbek audio. W praktyce oznacza to, że system analizuje barwę, tempo mówienia, akcent, sposób intonacji oraz charakterystyczne cechy wypowiedzi, a następnie odtwarza je w nowych nagraniach generowanych z tekstu. To rozwiązanie może być szczególnie przydatne dla marek osobistych, ekspertów, twórców internetowych i firm, które chcą zachować spójny ton komunikacji w wielu materiałach. voice cloning pozwala tworzyć nagrania szybciej, bez konieczności każdorazowego siadania przed mikrofonem. Jednocześnie warto pamiętać, że klonowanie głosu AI powinno być wykorzystywane odpowiedzialnie, za zgodą osoby, której głos jest odtwarzany.

Na czym polega voice cloning

Voice cloning w ElevenLabs opiera się na dostarczeniu próbek głosu, które narzędzie wykorzystuje do stworzenia indywidualnego profilu lektora. Im lepsza jakość nagrań, tym bardziej naturalny i wiarygodny będzie efekt końcowy. Najlepiej przygotować materiał nagrany w spokojnym otoczeniu, bez szumów, pogłosu, muzyki w tle czy zakłóceń technicznych. Ważne jest również, aby mówić naturalnie, w różnych tempach i z różną intonacją, ponieważ dzięki temu system lepiej rozpoznaje styl wypowiedzi. Własny głos AI może później zostać wykorzystany do generowania narracji, reklam, filmów edukacyjnych, podcastów czy komunikatów firmowych. Dobrze przygotowany cyfrowy lektor pomaga zachować rozpoznawalność marki i przyspiesza produkcję treści audio.

Najczęstsze błędy przy klonowaniu głosu

Najczęstszym błędem przy klonowaniu głosu jest używanie nagrań słabej jakości. Jeśli próbka zawiera szumy, echo, nierówne tempo, przyciszony głos lub dźwięki otoczenia, efekt może brzmieć sztucznie i mniej profesjonalnie. Drugim problemem jest zbyt mała liczba próbek albo nagrania wypowiadane w jednym, monotonnym stylu. Wtedy generator głosu AI ma mniej danych do odwzorowania naturalnej ekspresji. Warto też unikać przesadnie długich, skomplikowanych zdań w tekstach generowanych później przez narzędzie, ponieważ mogą obniżać płynność nagrania. Dobre rezultaty daje dopiero połączenie jakościowego materiału wejściowego, poprawnie przygotowanego scenariusza i testowania różnych ustawień. Dzięki temu ElevenLabs może stworzyć głos, który brzmi naturalnie, spójnie i wiarygodnie.

Najlepsze praktyki tworzenia naturalnie brzmiącego lektora AI

Choć narzędzia takie jak ElevenLabs oferują bardzo zaawansowaną syntezę mowy AI, ostateczna jakość nagrania w dużej mierze zależy od tego, jak użytkownik przygotuje tekst i skonfiguruje ustawienia. Naturalnie brzmiący lektor AI to efekt połączenia technologii oraz świadomego podejścia do tworzenia treści audio. W przeciwieństwie do tradycyjnego pisania tekstów na bloga czy stronę internetową, tutaj kluczowe znaczenie ma to, jak dana treść „brzmi”, a nie tylko jak wygląda. Dlatego warto traktować proces tworzenia nagrania jak pracę z prawdziwym lektorem – z uwzględnieniem rytmu wypowiedzi, emocji oraz odbiorcy końcowego. Wdrożenie kilku sprawdzonych praktyk pozwala znacząco poprawić jakość materiałów i sprawić, że odbiorca nie odróżni głosu syntetycznego od ludzkiego.

Jak pisać tekst pod syntezę mowy

Podstawą dobrego nagrania jest odpowiednio przygotowany tekst. W przypadku audio należy unikać długich, złożonych zdań i skomplikowanych konstrukcji językowych. Zamiast tego warto stosować krótsze, bardziej naturalne wypowiedzi, które przypominają język mówiony. Pomocne jest również dzielenie treści na logiczne fragmenty oraz stosowanie interpunkcji, która wpływa na rytm i tempo czytania. tekst pod syntezę mowy powinien być prosty, klarowny i dopasowany do odbiorcy – inaczej będzie wyglądał scenariusz do reklamy, a inaczej do materiału edukacyjnego. Dobrą praktyką jest także czytanie tekstu na głos przed jego wygenerowaniem – jeśli brzmi nienaturalnie, to generator głosu AI również nie odda go w przekonujący sposób.

Ustawienia tonu, emocji i pauz

Kolejnym elementem wpływającym na jakość nagrania są ustawienia dostępne w narzędziu. ElevenLabs pozwala regulować parametry takie jak stabilność głosu, ekspresję czy tempo wypowiedzi. W zależności od celu materiału można uzyskać bardziej dynamiczny lub spokojny efekt. ustawienia głosu AI powinny być dopasowane do kontekstu – reklama wymaga większej energii, natomiast materiał ekspercki powinien być bardziej stonowany i rzeczowy. Ogromne znaczenie mają również pauzy, które wpływają na odbiór komunikatu i jego zrozumiałość. Dobrze zaplanowane przerwy między zdaniami sprawiają, że AI voice brzmi bardziej naturalnie i jest łatwiejszy w odbiorze.

Unikanie sztucznego brzmienia

Jednym z największych wyzwań przy pracy z AI jest uniknięcie efektu sztuczności. Najczęściej wynika on z połączenia zbyt skomplikowanego tekstu, złych ustawień lub niewłaściwego dopasowania głosu. Aby temu zapobiec, warto testować różne warianty nagrań i porównywać efekty. Czasami drobna zmiana w tekście lub parametrach może znacząco poprawić jakość końcową. naturalny lektor AI to taki, który nie przyciąga uwagi swoją formą, lecz wspiera przekaz i pozwala skupić się na treści. Dlatego warto traktować ElevenLabs jako narzędzie do optymalizacji i eksperymentowania, a nie jednorazowego generowania nagrań bez kontroli jakości.

Ile kosztuje ElevenLabs i czy warto inwestować w AI voice?

Koszt korzystania z ElevenLabs zależy głównie od tego, ile treści tworzysz i jakich funkcji potrzebujesz. Platforma działa w modelu subskrypcyjnym – oferuje darmowy plan na start oraz kilka płatnych pakietów dopasowanych zarówno do indywidualnych twórców, jak i firm.

Możesz spokojnie przetestować narzędzie bez żadnych kosztów, a dopiero później zdecydować, czy warto przejść na płatny plan. Najważniejsze jest jednak patrzenie nie tylko na cenę, ale przede wszystkim na oszczędność czasu i znaczne uproszczenie całej produkcji audio. Dla wielu osób i firm ElevenLabs szybko staje się tańszą i wygodniejszą alternatywą dla tradycyjnego nagrywania z lektorem.

Dostępne plany i ceny (stan na 2026)

ElevenLabs oferuje następujące poziomy subskrypcji:

- Darmowy plan – idealny na początek. Daje 10 000 znaków miesięcznie i pozwala przetestować jakość głosów oraz podstawowe funkcje.

- Starter – 6 $/miesiąc – pierwszy sensowny plan z prawami komercyjnymi i dostępem do Instant Voice Cloning.

- Creator – 22 $/miesiąc (pierwszy miesiąc często w promocji za 11 $) – najpopularniejszy wybór wśród twórców. Oferuje 100 000 znaków, profesjonalne klonowanie głosu i wyższą jakość audio.

- Pro – 99 $/miesiąc – dla bardziej zaawansowanych użytkowników i agencji (500 000 znaków + dodatkowe funkcje API).

Powyżej znajdują się jeszcze droższe plany Scale i Business dla dużych zespołów i wysokiej produkcji.

Wybór planu powinien zależeć od Twoich realnych potrzeb. Jeśli tworzysz treści sporadycznie – wystarczy Starter lub Creator. Przy regularnej produkcji kilku–kilkunastu materiałów miesięcznie Creator lub Pro zwykle szybko się zwraca.

Co wpływa na rzeczywisty koszt generowania głosu?

Na całkowity koszt korzystania z narzędzia wpływa kilka czynników. Najważniejszym z nich jest ilość generowanego tekstu – im więcej materiałów tworzysz, tym większe zużycie limitu. Znaczenie ma również jakość generowanego głosu oraz wykorzystanie dodatkowych funkcji, takich jak klonowanie głosu czy bardziej zaawansowane ustawienia. Warto też uwzględnić kontekst biznesowy – jeśli dzięki temu rozwiązaniu możesz szybciej publikować treści, testować różne komunikaty i ograniczyć koszty produkcji, inwestycja zaczyna się zwracać. W wielu przypadkach narzędzie tego typu pozwala nie tylko zoptymalizować wydatki, ale też zwiększyć skalę działań bez konieczności rozbudowy zespołu.

Alternatywy dla ElevenLabs – porównanie narzędzi do syntezy mowy

Choć ElevenLabs jest jednym z najpopularniejszych narzędzi do generowania głosu, na rynku dostępnych jest również kilka innych rozwiązań, które warto rozważyć. Każde z nich ma swoje mocne strony i sprawdza się w nieco innych zastosowaniach – od prostych komunikatów systemowych po zaawansowane projekty marketingowe. Wybór odpowiedniego narzędzia powinien zależeć od potrzeb biznesowych, budżetu oraz oczekiwanej jakości nagrań. Poniżej znajdziesz porównanie najważniejszych platform, które mogą stanowić alternatywę dla ElevenLabs.

| Narzędzie | Jakość głosu | Personalizacja / Voice Cloning | Najlepsze zastosowanie | Poziom zaawansowania / Łatwość użycia | Cena startowa (miesięcznie) |

|---|---|---|---|---|---|

| ElevenLabs | Bardzo wysoka, najbardziej naturalna | Wybitna (Instant + Professional Voice Cloning) | Content marketing, reklamy, YouTube, podcasty, filmy | Łatwy dla początkujących / bardzo zaawansowany | Free → Starter $5 / Creator $22 |

| PlayHT | Bardzo dobra | Dobra (szybkie klonowanie + emocje) | Podcasty, dłuższe formy audio, marketing | Średni / zaawansowany | od ok. $29–39 |

| Amazon Polly | Dobra, stabilna (bardziej techniczna) | Ograniczona (głównie enterprise) | Systemy IVR, aplikacje biznesowe, duże projekty AWS | Zaawansowany (dla deweloperów) | Pay-as-you-go (od ok. $4–16 za milion znaków) |

| Google Cloud Text-to-Speech | Dobra, ale techniczna | Ograniczona | Aplikacje, asystenci głosowi, integracje Google | Ograniczona | free tier + pay-as-you-go |

Google Text-to-Speech

Rozwiązanie od Google to jedna z najstarszych i najbardziej stabilnych technologii syntezy mowy na świecie. Opiera się na potężnej infrastrukturze Google Cloud, co czyni ją wyborem numer jeden dla deweloperów budujących złożone ekosystemy. Sprawdza się przede wszystkim w aplikacjach mobilnych, asystentach głosowych oraz systemach, gdzie kluczowa jest niezawodność, niskie opóźnienia i głęboka integracja z innymi usługami chmurowymi. Mimo dostępu do technologii WaveNet, głosy Google wciąż brzmią nieco bardziej „technicznie” i mniej emocjonalnie niż u konkurencji. Z tego powodu rzadziej wykorzystuje się je w kreatywnym marketingu, a częściej w komunikatach systemowych, nawigacjach czy czytnikach treści na stronach internetowych.

Amazon Polly

Amazon Polly to zaawansowana usługa w ramach AWS (Amazon Web Services), stworzona z myślą o skalowalności i zastosowaniach korporacyjnych. Oferuje szeroki wybór głosów w wielu językach, w tym wersje „Neural”, które znacząco poprawiają płynność mowy. Jej największą zaletą jest elastyczność – Polly pozwala na precyzyjne sterowanie wymową za pomocą znaczników SSML, co jest niezwykle przydatne dla firm i deweloperów potrzebujących pełnej kontroli nad akcentem czy tempem. Choć jest to narzędzie niezwykle stabilne i tanie przy masowej produkcji, wciąż ustępuje nowszym rozwiązaniom AI pod kątem oddawania głębokich, ludzkich emocji. Idealnie nadaje się do systemów IVR (automatyczna obsługa klienta), e-learningu oraz dużych platform wymagających wysokiej dostępności.AI.

PlayHT i inne rozwiązania

PlayHT to obecnie jedna z najciekawszych i najbardziej dynamicznie rozwijających się alternatyw dla ElevenLabs. Platforma ta zyskała popularność dzięki agregowaniu głosów z różnych silników (w tym własnych modeli AI) oraz bardzo intuicyjnemu edytorowi, który pozwala na precyzyjne ustawianie emocji i pauz bezpośrednio w tekście. Jest to narzędzie skrojone pod potrzeby twórców treści, podcasterów i marketerów, oferując rozbudowane opcje personalizacji oraz coraz lepszy mechanizm klonowania głosu. Na rynku pojawiają się także inne rozwiązania, takie jak Murf AI czy Lovo, które próbują walczyć o uwagę użytkowników, jednak to właśnie ElevenLabs i PlayHT wyznaczają obecnie kierunek rozwoju technologii audio AI, stawiając na maksymalny realizm, łatwość obsługi i wysoką jakość generowanego dźwięku.

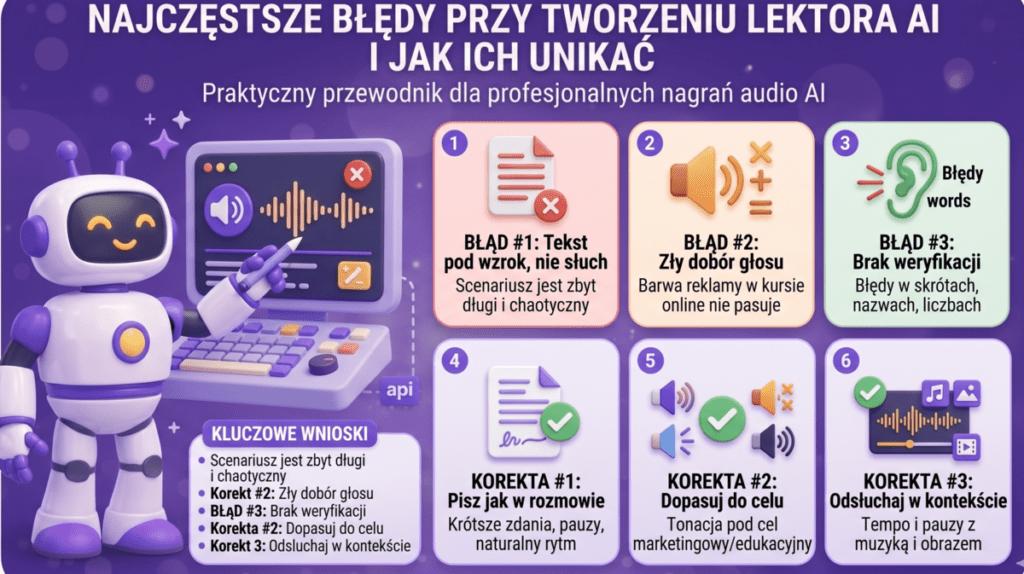

Najczęstsze błędy przy tworzeniu lektora AI i jak ich unikać

Tworzenie lektora AI jest błyskawiczne, jednak pierwsza próba rzadko brzmi idealnie. Najczęstszym błędem jest traktowanie narzędzia jako prostego konwertera tekstu, z pominięciem zasad komunikacji audio. Nawet najlepsza technologia text to speech nie naprawi scenariusza, który jest zbyt długi lub napisany wyłącznie pod czytanie wzrokiem. Aby uzyskać naturalny efekt, treść należy przygotować tak, jakby miała być wypowiedziana w swobodnej rozmowie. Krótsze zdania, logiczne pauzy i jasny rytm wypowiedzi to klucz do tego, by lektor AI brzmiał wiarygodnie i profesjonalnie.

Równie istotny jest trafny dobór głosu do celu nagrania. Barwa idealna do dynamicznej reklamy sprzedażowej nie sprawdzi się w merytorycznym kursie online, prezentacji eksperckiej czy długim audiobooku. Przed generowaniem pliku warto określić, jakie emocje ma budować przekaz – inna tonacja wspiera funkcję informacyjną w materiałach B2B, a inna buduje zaangażowanie w social mediach. Należy przy tym unikać przesadnej ekspresji w ustawieniach, którą oferuje ai voice generator, ponieważ może ona nadać nagraniu sztuczny, teatralny charakter.

Ostatnią pułapką jest brak finalnej weryfikacji nagrania. AI może błędnie odczytać skrót, liczbę lub nazwę własną, co rzutuje na wizerunek marki. Przed publikacją konieczne jest odsłuchanie całości, najlepiej w połączeniu z docelową muzyką lub obrazem. Pozwala to sprawdzić, czy tempo i pauzy współgrają z rytmem materiału i czy komunikat nie ginie w tle. Tylko dzięki takiemu podejściu cyfrowy lektor przestaje być technologiczną nowinką, a staje się skutecznym narzędziem wspierającym nowoczesną promocję i sprzedaż.

Przyszłość cyfrowych lektorów – jak AI zmienia branżę audio i wideo

Rozwój technologii głosowych opartych na sztucznej inteligencji wyraźnie przyspiesza, a nowoczesne rozwiązania z zakresu audio AI stają się standardem w profesjonalnej produkcji. Narzędzia, które jeszcze kilka lat temu oferowały mechaniczne brzmienie, dziś zapewniają realizm pozwalający na szerokie zastosowanie w marketingu, edukacji i rozrywce. Platformy takie jak ElevenLabs konsekwentnie wprowadzają nowe funkcje, które przesuwają granice możliwości syntezy mowy. Dzięki temu firmy mogą błyskawicznie tworzyć profesjonalne nagrania, testować różne warianty komunikatów i skalować produkcję treści bez angażowania ogromnych budżetów.

Jednym z najważniejszych kierunków rozwoju jest personalizacja oraz klonowanie głosu, co pozwala markom na tworzenie unikalnej i spójnej tożsamości dźwiękowej. Możliwość wygenerowania materiałów wideo, audiobooków czy krótkich form na platformy takie jak TikTok przy użyciu jednego, rozpoznawalnego głosu buduje silną więź z odbiorcą. Ciągła ewolucja audio AI sprawia, że generowana mowa coraz lepiej oddaje subtelne emocje, akcenty i niuanse językowe, co jest kluczowe w kampaniach realizowanych na rynkach międzynarodowych.

Postęp niesie ze sobą również wyzwania, szczególnie w obszarze ochrony prywatności i bezpieczeństwa danych. Twórcy narzędzi kładą coraz większy nacisk na systemy zabezpieczeń i kontrolę dostępu, aby zapobiegać nadużyciom związanym z wykorzystaniem cudzych głosów. Jednocześnie rozbudowane interfejsy API pozwalają deweloperom na głęboką integrację funkcji głosowych z aplikacjami mobilnymi i systemami biznesowymi, co otwiera drogę do pełnej automatyzacji komunikacji z klientem.

Patrząc strategicznie, cyfrowi lektorzy będą odgrywać kluczową rolę w operacjach marketingowych. Szybkie wdrażanie nowych treści oraz możliwość ich masowej produkcji sprawiają, że firmy mogą reagować na trendy rynkowe niemal w czasie rzeczywistym. Narzędzia oparte na audio AI budują kompletny ekosystem, który wspiera sprzedaż i poprawia doświadczenia użytkowników. Dla biznesu oznacza to jedno – sztuczna inteligencja w obszarze dźwięku przestała być jedynie nowinką, a stała się fundamentem nowoczesnej i efektywnej komunikacji.

Sprawdź również:

- Lyria 3 od Google – rewolucja w tworzeniu muzyki z AI

- NotebookLM – co to jest i jak działa?

- Sora 2 – czym jest i jakie daje możliwości? Nowa era generowania wideo przez AI

- TOP 7 najlepszych narzędzi AI do generowania wideo